AI一天,人间一年

大家好啊,我是小卷,最近AI绘画又发展出一些新玩意了,小卷因为工作的关系有一个月没关注AI的发展了,都有点跟不上版本节奏了。。。

1.comfyui的使用效果

今天给大家介绍下AI绘画新的工具:ComfyUI。和Stable Diffusion Webui类似的,支持文生图,图生图的基本操作,不同的是comfyui是工作流式的操作,这里没有了解sd-webui也不要紧,我们用comfyui+SVD进行AI绘画,以及生成动态视频

comfyui的开源地址:ComfyUI

还是老规矩,先看视频效果:

player.bilibili.com/player.html…

来看个效果更加炸裂的示例

- 原始图片

- 生成的视频效果图

2.云端部署步骤

本地部署会存在各种问题,这里教大家用云端服务器进行部署,只需要3分钟就能完成comfyui的搭建,很快就能用上哦~

平台推荐:揽睿星舟

注册地址:www.lanrui-ai.com/register?in…

通过上面地址注册会有2小时算力领取,完全够新手入门玩哦~

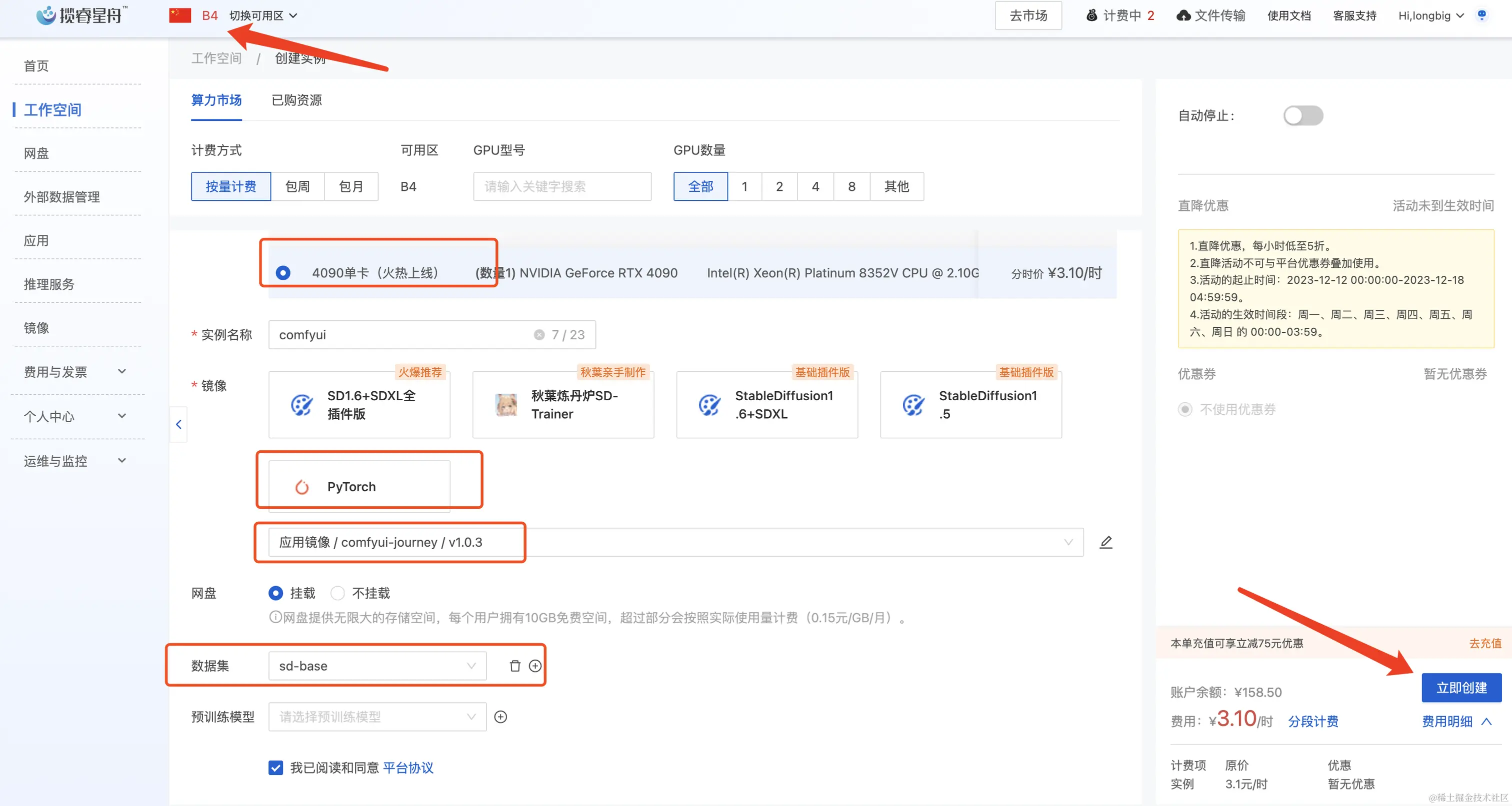

2.1创建工作空间

在工作空间页面选择B4区,实例选择4090单卡,镜像选择应用镜像/comfyui-journey/v1.0.3,挂载网盘,数据集选择sd-base,然后点击创建即可。如下图:

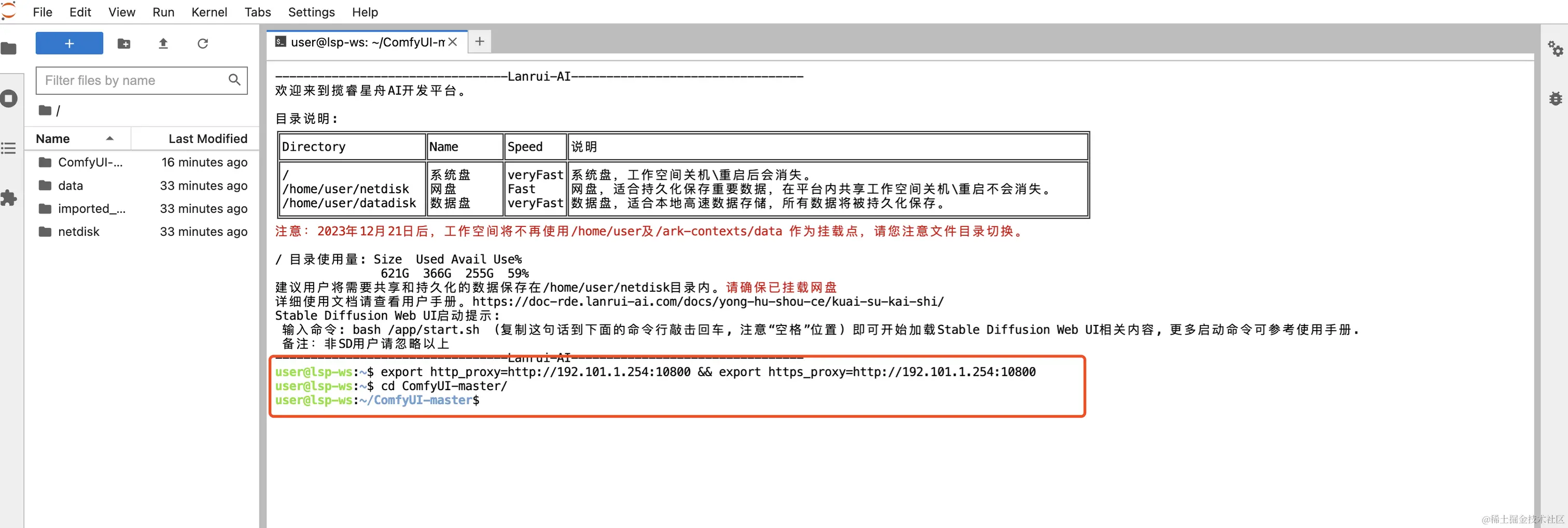

2.2配置学术加速

实例创建完成后,在工作空间界面进入Jupyter页面,如图:

然后新建一个终端,并执行以下命令:

- 先使用学术加速

arduino复制代码export http_proxy=http://192.101.1.254:10800 && export https_proxy=http://192.101.1.254:10800

- 进入Comfyui目录

bash复制代码cd ComfyUI-master/

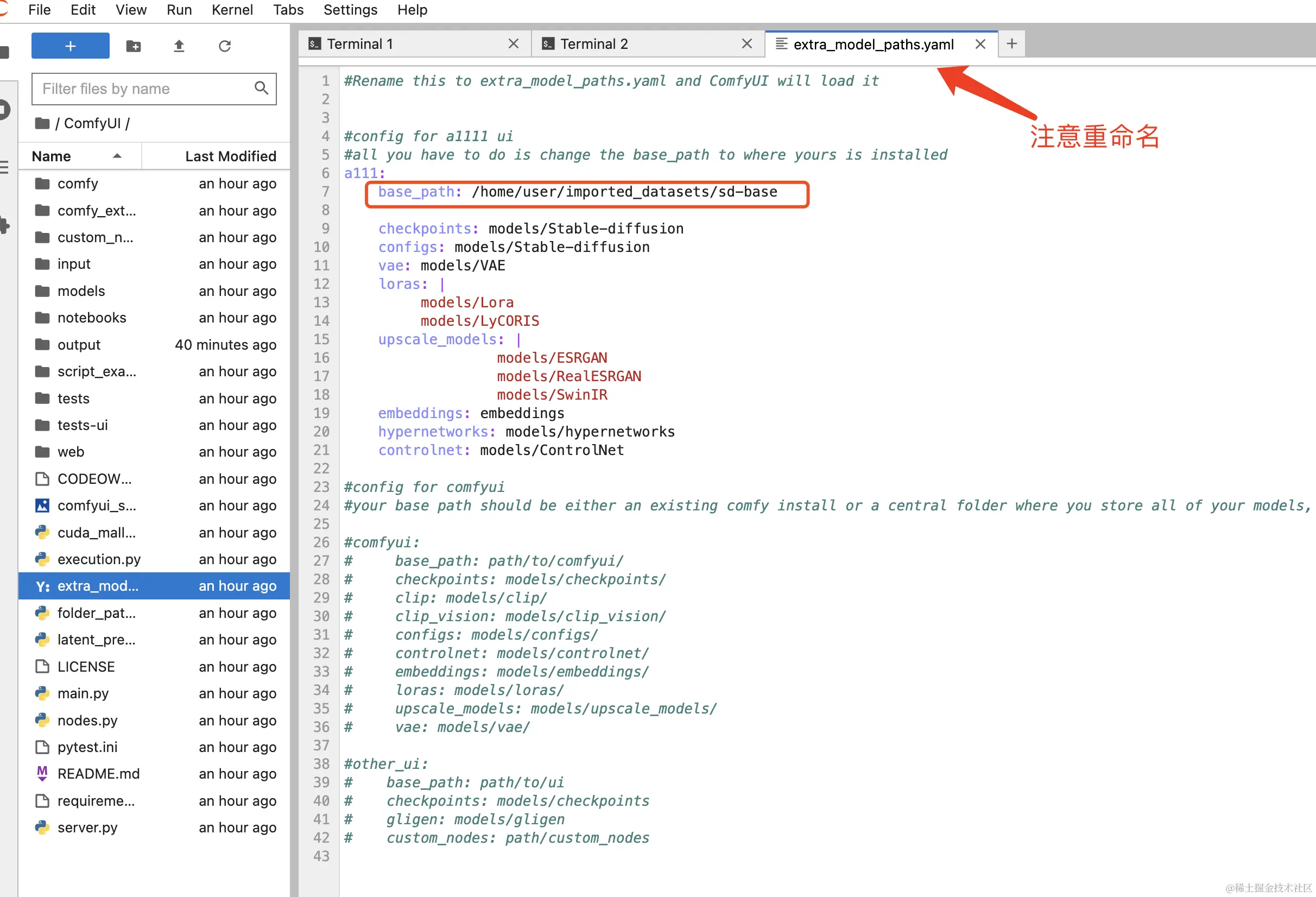

2.4配置模型地址

我们在创建工作空间的时候已经选择sd-base的数据集,这里只需要改下Comfyui加在模型的path就行了,修改步骤往下看:

- 在ComfyUI目录下,找到

extra_model_paths.yaml.example文件,重命名为extra_model_paths.yaml - 修改文件内的

base_path参数,修改为模型目录的绝对地址,这里因为我们已经选了sd-base的数据集,所以用/home/user/imported_datasets/sd-base,修改内容如下图:

2.5 启动ComfyUI

到这步,准备工作都完成了,在ComfyUI目录下执行下面这条命令,启动ComfyUI,并将服务映射到工作空间的27777端口

css复制代码python3 main.py --port 27777 --listen 0.0.0.0

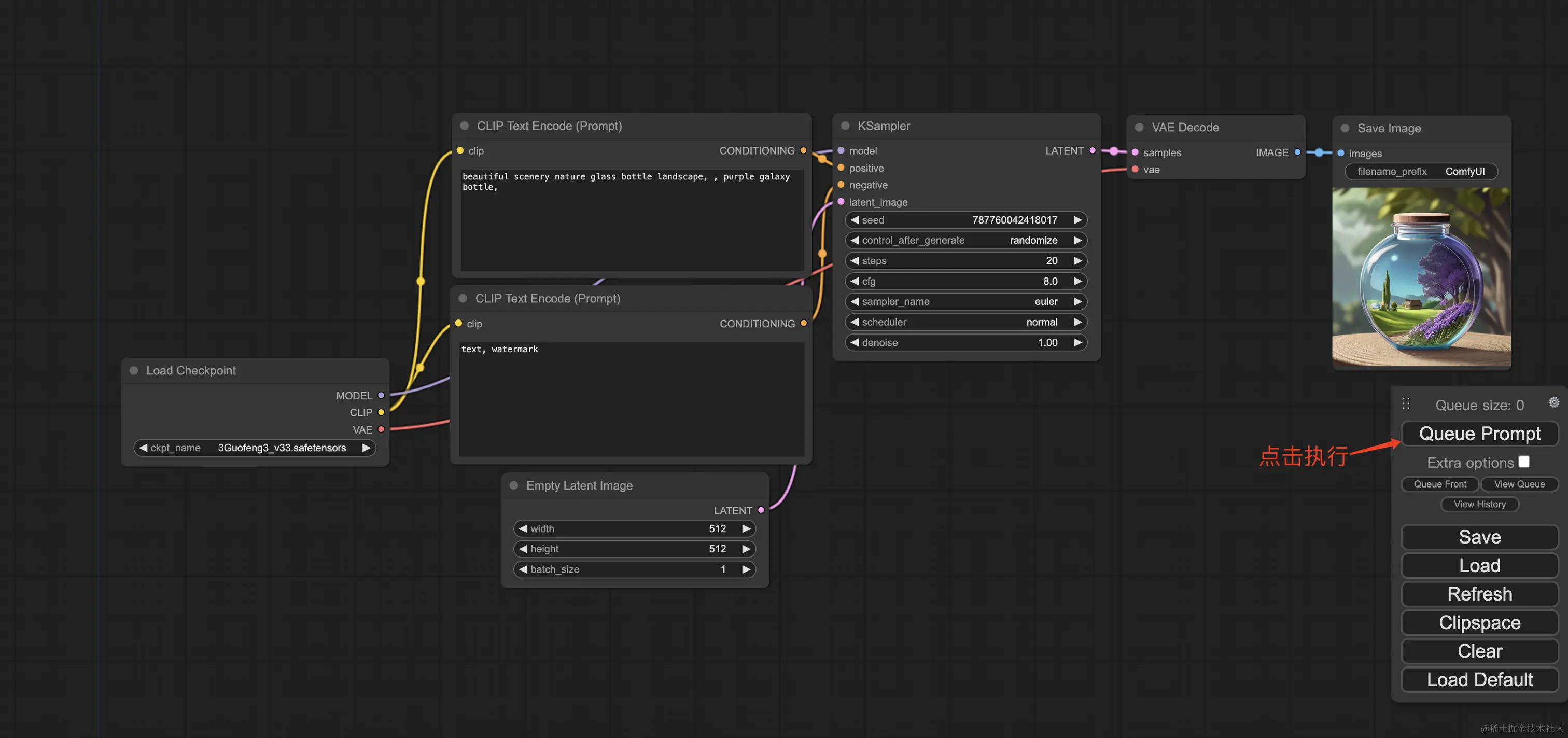

启动完成后,到工作空间复制调试地址,到浏览器打开,就能看着ComfyUI的使用界面了。

默认工作流可生成一张水瓶的图片,大家可以点击Queue Prompt试试

4.安装SVD插件

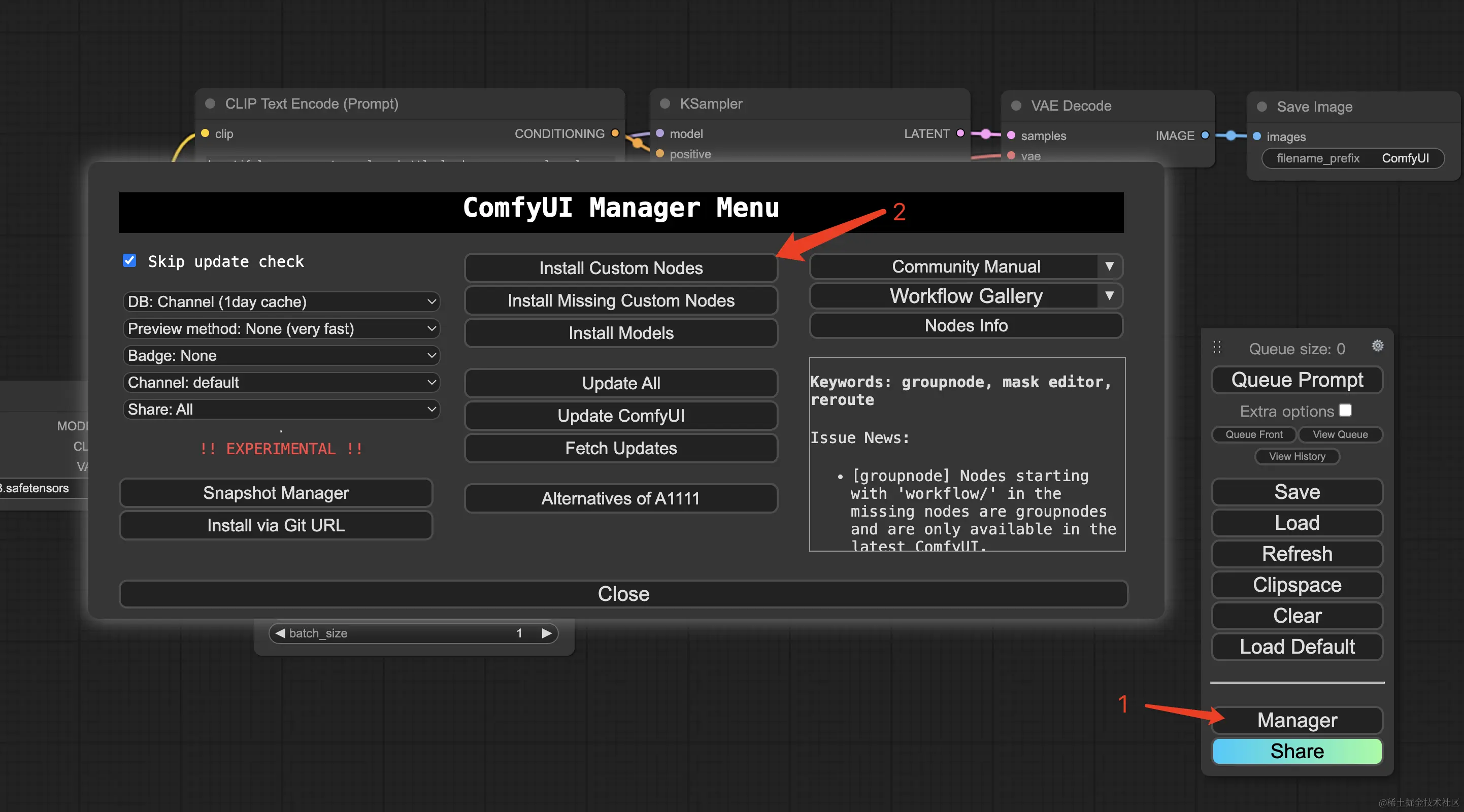

点击Manager,然后点击弹出菜单里的Install Custom Nodes,接着搜索svd

选择ComfyUI-SVD进行安装,操作过程如图:

等待几分钟安装完成后需要重启,点击界面上出现的Restart按钮重启即可

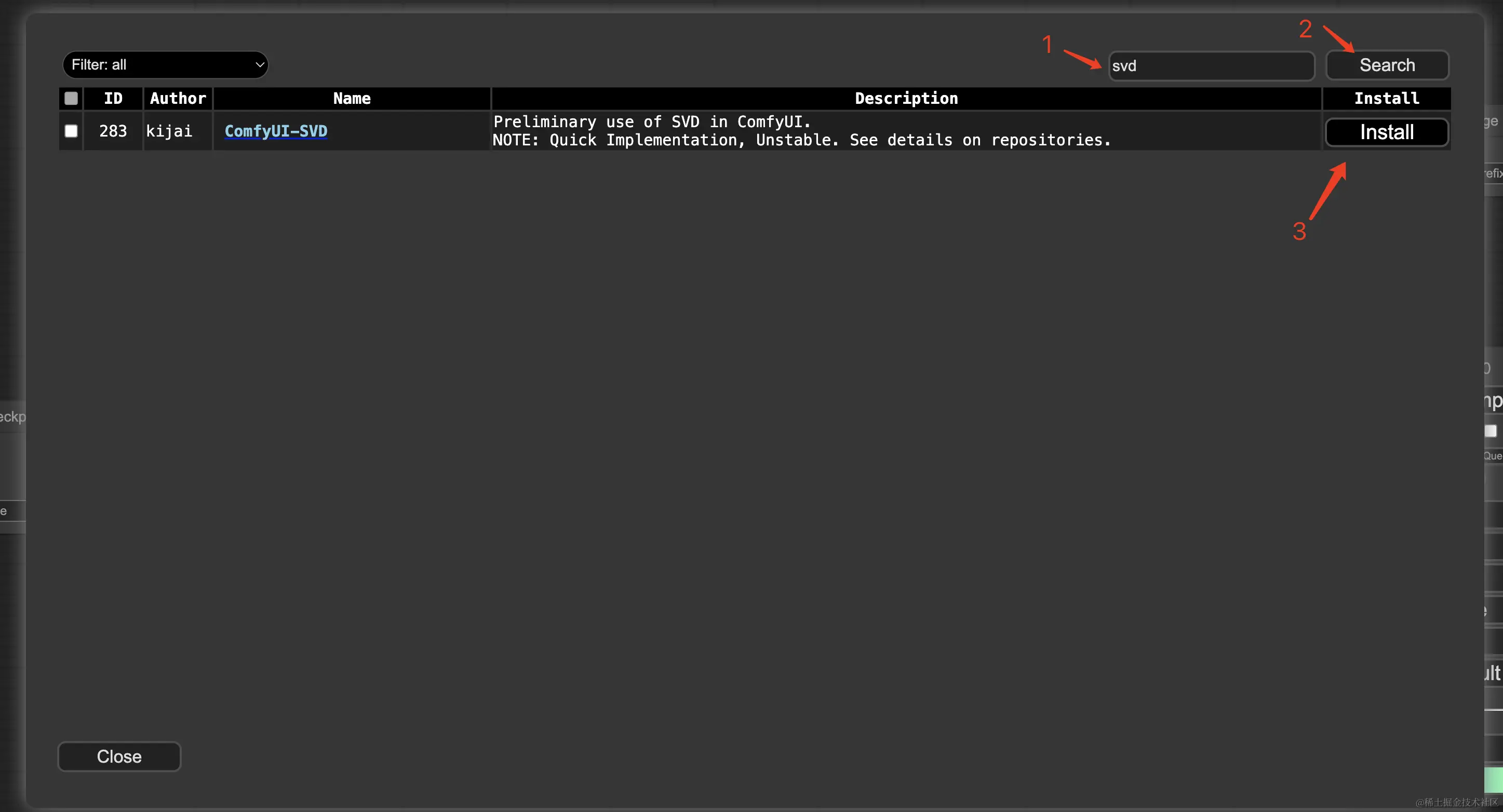

4.1安装svd大模型

我们接着安装svd的大模型,点击Manager,然后点击Install Models,在弹出的窗口中搜索svd,根据自己的显卡性能选择14帧或者25帧的模型,这里我们因为用的4090显卡,所以选25帧的安装,如图:

安装过程比较长,等待10分钟左右可安装完成

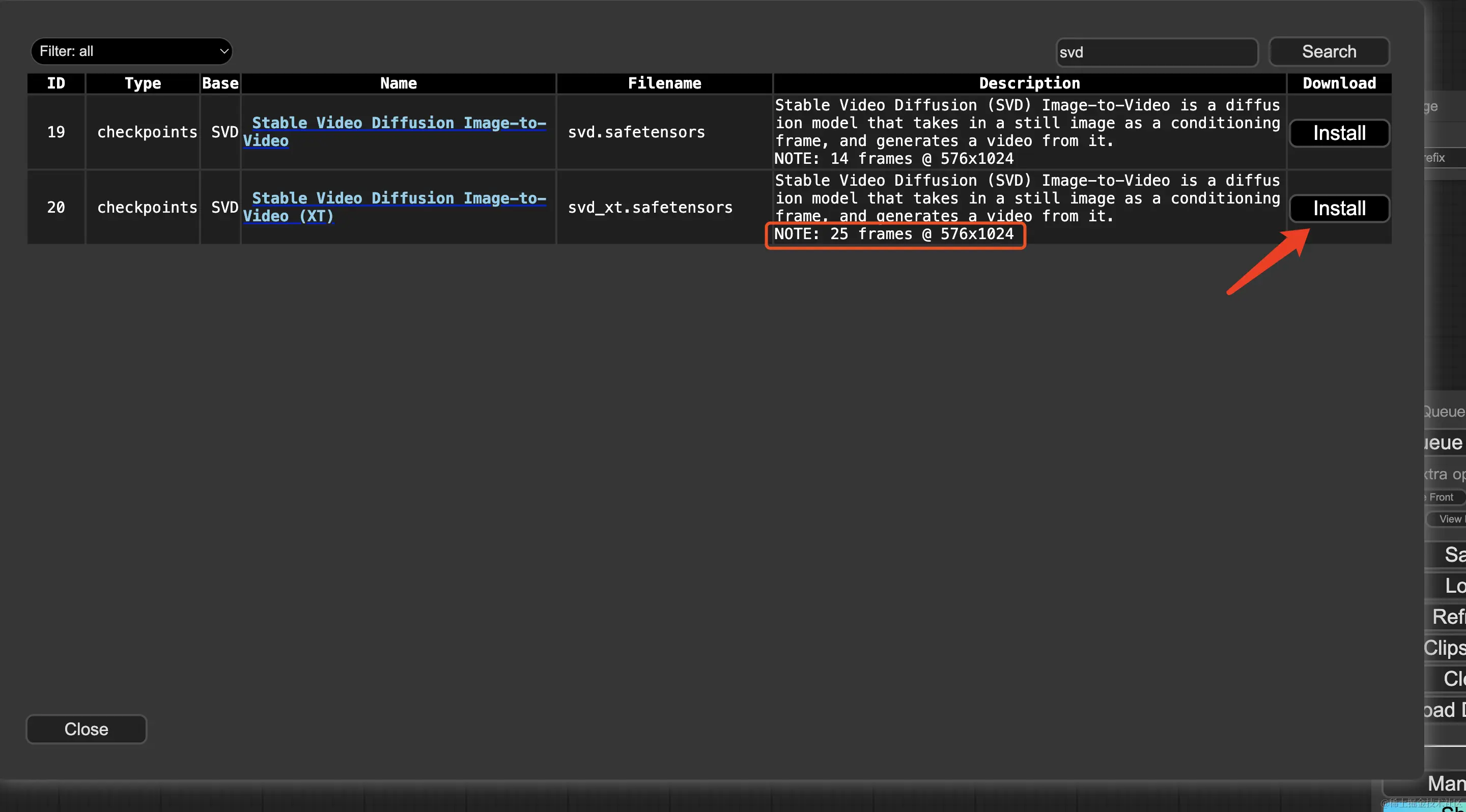

4.2导入图片转视频工作流

我们从comfyui官方GIthub上下载工作流文件进行导入,或者直接用拖拽的形式把图片拖到ComfyUI里就自动导入,如图操作:

Comfyui地址:comfyanonymous.github.io/ComfyUI_exa…

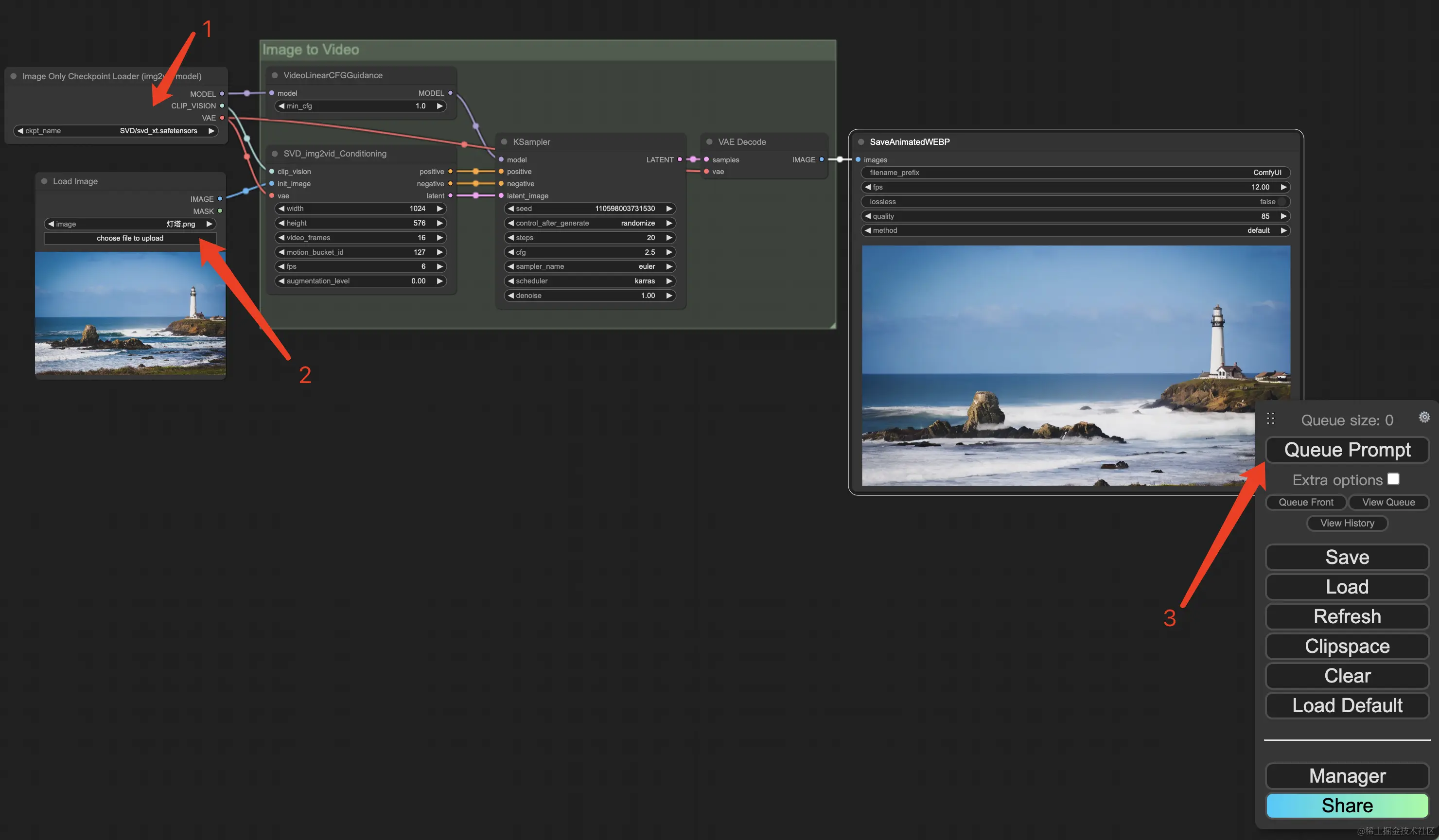

5 图片转视频操作

我们选择一张图片上传,然后选中svd_xt的大模型,参数值默认就行,点击Queue Prompt执行,等待几秒钟就可以看到结果了,默认工作流生成的视频是webp格式,可以用在线网站进行转换为Gif,然后再转MP4

在线网站:webpconverter.com/zh/webp-to-…

操作步骤如图:

最后把生成的多段视频用剪辑工具拼接起来,就得到文章开头的视频效果啦~

6.总结

ComfyUI是通过将stable diffusion的流程拆分成节点,实现了更加精准的工作流定制和完善的可复现性。但节点式的工作流也提高了一部分使用门槛。

最后,小卷想说的是工具的使用是提效的手段,不论用什么工具,最后生成的效果满意就行。就像做视频,手机、单反、运动相机都能拍,能不能拍出精彩的视频还是需要创作者的内功哦~

![[Release] Tree Of Savior](https://www.nicekj.com/wp-content/uploads/replace/4f98107ca1ebd891ea38f390f1226e45.png)

![[一键安装] 手游-天道情缘](https://www.nicekj.com/wp-content/uploads/replace/b441383e0c7eb3e52c9980e11498e137.png)

![[一键安装] 霸王大陆EP8-5.0 虚拟机+源码+大背包+商城-最新整理](https://www.nicekj.com/wp-content/uploads/thumb/replace/fill_w372_h231_g0_mark_0d204bcf457d56afaeacf1e97e86ee45.png)

![[一键安装] 龙之谷手游飓风龙单机版一键端 完整GM后台局域网](https://www.nicekj.com/wp-content/uploads/thumb/replace/fill_w372_h231_g0_mark_77ae8bb495cba3dd592ef131cc7aea5f.jpeg)